Forschende der TU München kombinieren 3D-Bilderkennung mit Sprachmodellen – und machen Roboter deutlich effizienter bei der Objektsuche.

Redaktionelle Bearbeitung: Technische Rundschau

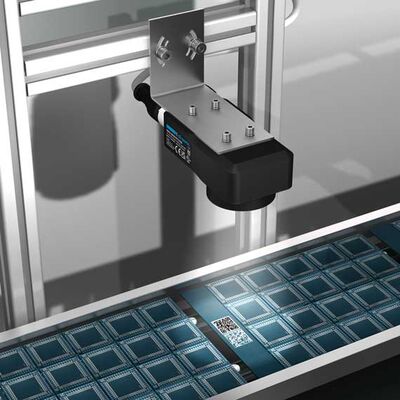

Ein Roboter, der verlorene Gegenstände auf Zuruf findet: Was nach Science-Fiction klingt, ist an der Technischen Universität München (TUM) Realität geworden. Das System verknüpft räumliche 3D-Umgebungsdaten mit Wissen aus Sprachmodellen, um gesuchte Objekte gezielt und effizient aufzuspüren.

Roboter «denkt» in Wahrscheinlichkeiten

Der am TUM Learning Systems and Robotics Lab entwickelte Suchroboter erstellt zunächst eine präzise dreidimensionale Karte seiner Umgebung. Mithilfe einer Kamera mit Tiefeninformation erkennt er Objekte und deren Position im Raum. Parallel analysiert ein Sprachmodell, welche Orte typischerweise für bestimmte Gegenstände relevant sind.

So weiss der Roboter beispielsweise, dass eine Brille eher auf einem Tisch oder einer Fensterbank liegt als auf einer Herdplatte. Diese Informationen werden in Wahrscheinlichkeiten übersetzt, die auf der Karte visualisiert sind – und den Roboter gezielt zu den vielversprechendsten Suchorten führen.

Das Ergebnis: Die Suche erfolgt rund 30 Prozent effizienter als bei einer zufälligen Navigation.

Kombination aus Bildverständnis und Sprach-KI

Die Innovation liegt in der Verbindung zweier KI-Ansätze:

- 3D-Bilderkennung für das räumliche Verständnis

- Sprachmodelle für kontextuelles Wissen über Objekte

«Wir haben dem Roboter beigebracht, die Umgebung zu verstehen», erklärt Projektleiterin Prof. Angela Schoellig. Ziel ist es, autonome Systeme zu entwickeln, die sich in dynamischen Umgebungen sicher und selbstständig bewegen können.

Roboter erkennt Veränderungen zuverlässig

Ein weiterer Vorteil: Der Roboter speichert frühere Szenen und vergleicht sie mit aktuellen Bildern. Neue oder veränderte Objekte erkennt er mit einer Trefferquote von rund 95 Prozent – und priorisiert diese Bereiche automatisch bei der Suche.

Nächster Schritt: Blick hinter Türen und in Schubladen

Künftig soll der Roboter auch Objekte finden, die sich hinter Türen oder in Schubladen befinden. Dafür muss er aktiv mit seiner Umgebung interagieren – etwa Schränke öffnen und deren Mechanik verstehen.

Impressum

Textquelle: Technische Universität München

Bildquelle: Technische Universität München

Redaktionelle Bearbeitung: Technische Rundschau

Informationen

Weitere Artikel

- 3D-Bilderkennung

- autonome Roboter

- industrielle Robotik

- KI-Roboter

- Objektsuche KI

- Robotik Forschung

- Sprachmodell Robotik

- Suchroboter

- TU München Robotik

Veröffentlicht am: